美國國家標準與技術研究院 (NIST) 近日發佈了有關惡意機器學習 (AML) 攻擊緩解指南, 呼籲企業組織需高度關注近年來人工智慧 (AI) 系統部署增加所帶來的隱私和安全挑戰,並表示這類系統目前沒有萬無一失的保護方法。

NIST指出,這些安全和隱私挑戰包括惡意操縱訓練資料、惡意利用模型漏洞對AI系統的性能造成不利影響,甚至僅僅是與軟體模組互動,就可以洩漏個人、企業甚至是軟體模組本身專有的敏感性資料。

OpenAI ChatGPT 和 Google Bard 等生成式AI系統的出現,許多線上服務正快速導入,但支援這些技術的模型在機器學習操作的各個階段都面臨著許多威脅。NIST關注四種主要類型的攻擊:逃避、中毒、隱私和濫用。

- 規避攻擊:目的是在模型部署後產生惡意輸出。

- 中毒攻擊:通過引入損壞的資料,針對演算法的訓練階段進行攻擊。

- 隱私攻擊:目的是通過提出規避現有防護措施的問題,收集有關系統或其訓練資料的敏感資訊。

- 濫用攻擊:目的是破壞合法的資訊來源,如包含錯誤資訊的網頁,以重新利用系統的預期用途。

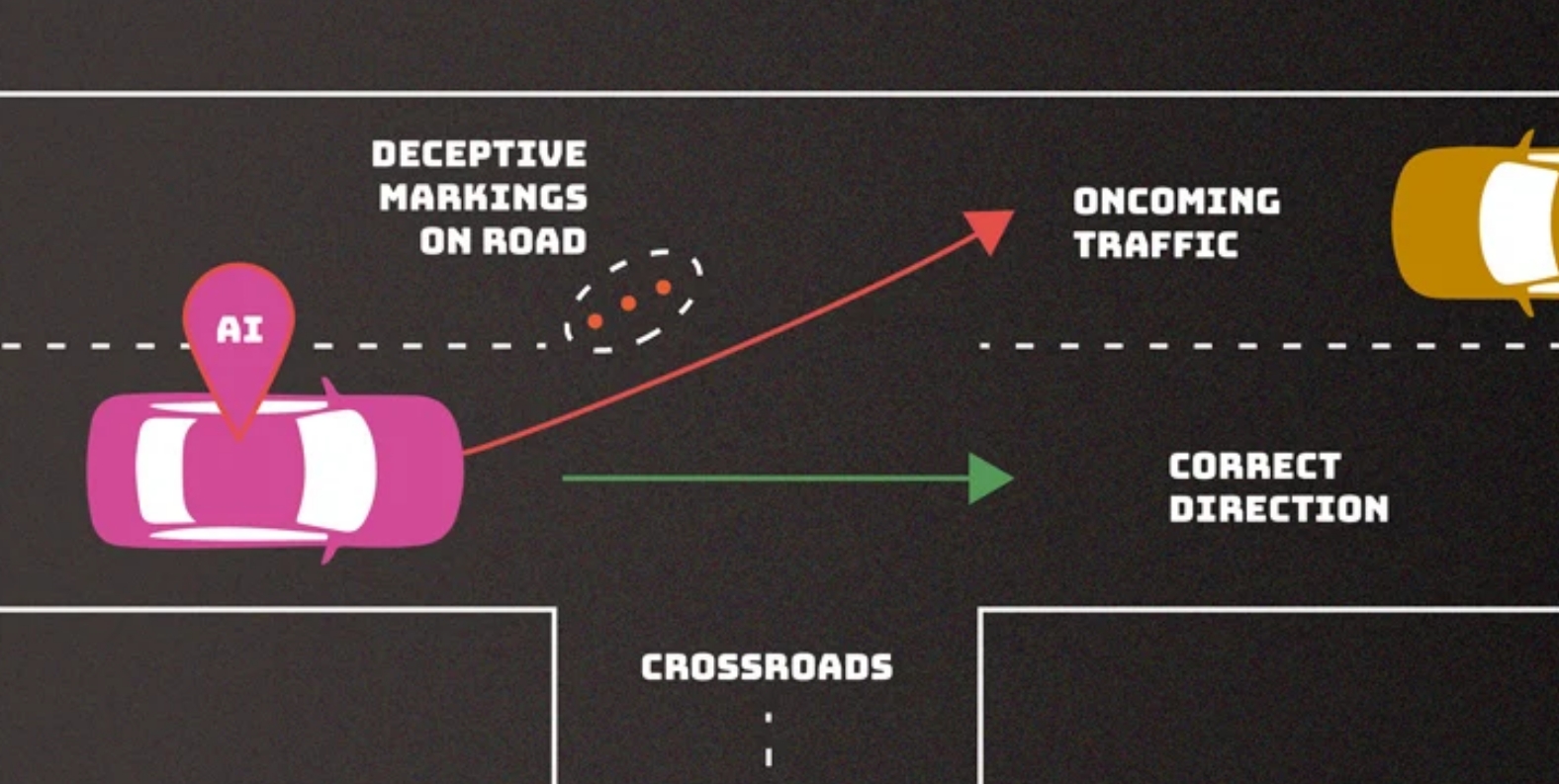

在規避攻擊中,NIST 以對自動駕駛車輛的攻擊作為示例,如建立令人困惑的車道標記導致汽車偏離道路。

惡意攻擊者可以利用規避攻擊手法建立錯誤或困惑的車道標記導致汽車偏離道路。

惡意攻擊者可以利用規避攻擊手法建立錯誤或困惑的車道標記導致汽車偏離道路。

在中毒攻擊中,攻擊者試圖在AI訓練期間引入損壞的資料。例如,通過將大量此類語言實例植入對話記錄中,讓聊天機器人使用不恰當的語言,以使AI相信這是常見的用語。

在隱私攻擊中,攻擊者試圖通過詢問聊天機器人大量問題,並使用給出的答案對模型進行逆向工程,進而發現弱點來獲取有關AI或其訓練資料中存在的敏感性資料。

濫用攻擊涉及將不正確的資訊插入到原始資料中,例如網頁或線上文檔,然後AI吸收這些資訊。與前面提到的中毒攻擊不同,濫用攻擊試圖從合法但受損的來源向AI提供不正確的資訊,以重新調整AI系統的預期用途。

NIST表示,上述攻擊並不需要完全掌握AI系統就可以實施攻擊,希望科技界能拿出更好的防禦措施來應對這些風險。

本文轉載自Thehackernews.com。

2024資安365年會:AI-資安新革命

面對AI的新世界,如何打造資安防護網?對於資安而言,AI將帶來前所未有的挑戰,但同時也將衍生前所未有的機會。資安人媒體將在2024年2月22日於富邦國際會議中心B2舉辦年度「資安365」年會,與我們一起關心即將到來的AI資安世界。點我看活動資訊!